22. Oktober 2025

KI und freier Wille: Können Maschinen frei entscheiden?

KI-Agenten treffen eigenständige Entscheidungen und korrigieren sich selbst. Aber entscheiden sie frei — oder zeigt die Frage etwas über unseren eigenen freien Willen?

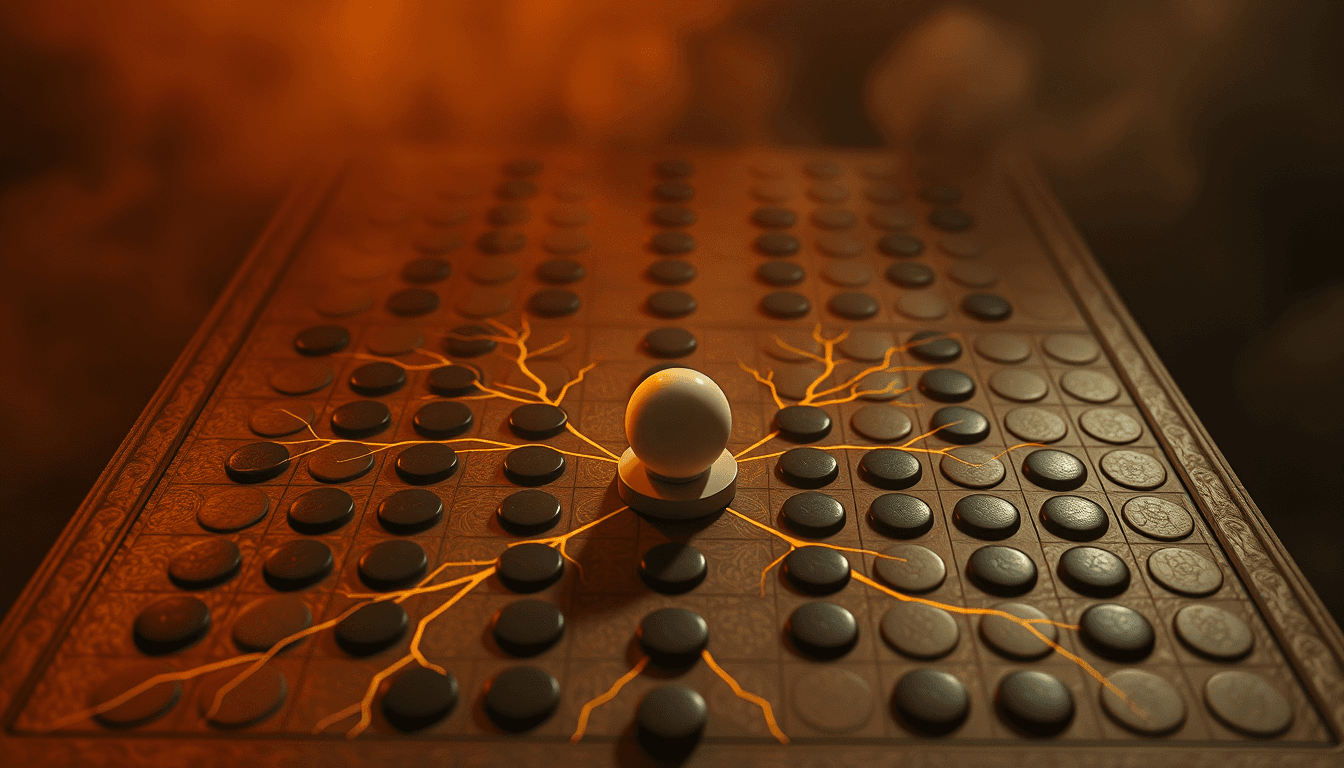

März 2016. AlphaGo spielt gegen den Go-Weltmeister Lee Sedol. Zug 37 in Partie 2. Ein Zug, den kein Mensch je gespielt hätte. Die Kommentatoren halten ihn für einen Fehler. Sedol steht vom Tisch auf, geht raus, raucht eine Zigarette.

Fünfzig Züge später hat AlphaGo gewonnen. Zug 37 war kein Fehler. Es war der beste Zug der Partie.

Niemand hat AlphaGo diesen Zug beigebracht. Das System hat ihn selbst gefunden, durch Millionen Partien gegen sich selbst.

War das eine freie Entscheidung?

Was ist freier Wille überhaupt?

Bevor wir über Maschinen reden, sollten wir ehrlich über uns selbst sein.

1983 führte der Neurowissenschaftler Benjamin Libet ein Experiment durch, das bis heute diskutiert wird. Probanden sollten eine einfache Handbewegung ausführen, wann immer sie wollten. Gleichzeitig maß Libet ihre Gehirnaktivität.

Das Ergebnis war verstörend: Das Gehirn begann die Bewegung vorzubereiten, messbar als sogenanntes Bereitschaftspotential, etwa 350 Millisekunden bevor die Versuchsperson bewusst entschied, die Hand zu bewegen.

Dein Gehirn entscheidet. Dann wirst du dir der Entscheidung bewusst. Dann glaubst du, du hättest entschieden.

Diese Reihenfolge ist seitdem vielfach repliziert worden.

Heißt das, freier Wille ist eine Illusion? Nicht unbedingt. Aber es heißt: Dein System 1, das automatische, unbewusste System, trifft die meisten deiner Entscheidungen, bevor dein bewusstes Denken überhaupt eingeschaltet wird. Dein System 2 rationalisiert hinterher.

Das ist unbequem. Und genau deshalb lohnt es sich, die Frage nach dem freien Willen auch bei Maschinen zu stellen.

Wie KI-Agenten entscheiden

2022 veröffentlichte Anthropic ein Paper über Constitutional AI. Die Idee: Statt einem KI-System von außen beizubringen, was es nicht tun soll, bekommt es ein Set von Prinzipien, eine Art Verfassung. Dann korrigiert es sich selbst.

Das System liest seine eigene Antwort. Prüft sie gegen seine Prinzipien. Überarbeitet sie. Ohne dass ein Mensch eingreift.

Das klingt verdächtig nach System 2.

Ein Forscherteam von Microsoft analysierte ein Jahr später GPT-4 auf Fähigkeiten jenseits der üblichen Benchmarks. Ihr Befund: „Funken allgemeiner Intelligenz." Das Paper war kontrovers, aber die Beobachtungen waren real. GPT-4 löste Aufgaben, für die es nie trainiert wurde.

2025 ging Anthropic noch weiter. Claude Opus 4 analysiert eigenständig Codebases, findet Bugs, schreibt Tests. Kein Mensch sagt ihm, wo er suchen soll.

Klingt beeindruckend. Ist es auch. Aber all das passiert auf Basis statistischer Muster aus Trainingsdaten. AlphaGos Zug 37 kam aus Millionen simulierten Partien. Claudes Code-Analyse kommt aus Milliarden Textfragmenten. Die Systeme optimieren auf Grundlage ihrer Vergangenheit.

Das tust du übrigens auch.

Wenn du wissen willst, was deine Entscheidungen wirklich antreibt — jenseits von Gewohnheit und Autopilot: Hier findest du einen strukturierten Weg, genau das herauszufinden.

Was dich von AlphaGo unterscheidet

Deine Gedanken entstehen aus neuronalen Mustern, geformt durch Gene, Erfahrung und Umgebung. Deine Entscheidungen laufen größtenteils unbewusst ab, Libets Bereitschaftspotential zeigt es. Deine Emotionen sind automatische Bewertungen von System 1, die du erst nachträglich bewusst verarbeitest.

In welchem Sinne bist du dann freier als AlphaGo?

Die Komplexität kann es nicht sein. KI-Systeme treffen längst kreative, unvorhersehbare Entscheidungen. Die Autonomie auch nicht. Claude Opus 4 arbeitet eigenständiger als mancher Berufseinsteiger.

Was bleibt, ist etwas anderes: Du hast eine subjektive Erfahrung. Wenn du eine Entscheidung triffst, ist da jemand, der sie trifft. Da ist ein Bewusstsein, das die Konsequenzen spürt, das die Entscheidung mit Bedeutung auflädt, wie wir im letzten Artikel besprochen haben.

AlphaGo hat Zug 37 gespielt. Aber es hat nichts dabei empfunden. Keinen Stolz. Keine Unsicherheit. Keinen Moment, in dem etwas auf dem Spiel stand.

Du sitzt vor einer schwierigen Entscheidung, und etwas in dir zieht sich zusammen. Das ist kein Bug. Das ist der Beweis, dass deine Entscheidungen für dich etwas bedeuten. Dass es ein Subjekt gibt, für das die Zukunft offen ist.

Vielleicht ist freier Wille keine Frage der Kausalität. Sondern die Frage, ob jemand da ist, der wählt.

KI-Agenten werden autonomer. Ihre Entscheidungen werden in immer mehr Bereichen besser als menschliche. Aber sie werden nie wissen, wie es sich anfühlt, eine Entscheidung zu treffen.

Das sagt wenig über die Maschine. Aber es sagt etwas über dich: Jedes Mal, wenn du vor einer Wahl stehst und spürst, dass sie zählt.

Maschinen optimieren. Du wählst. Wenn du verstehen willst, nach welchen Mustern du das tust — und wo du bewusster wählen könntest: Das hier ist ein guter Startpunkt.

Bleibe bewusst. Folge der Freude.

Wo bist du wirklich austauschbar – und wo nicht?

10 Fragen, die dir zeigen, ob du aus deiner Stärke arbeitest – oder aus Anpassung. Und wie du KI so nutzt, dass sie dich verstärkt statt verdrängt.

5-Minuten-CheckDas könnte dich auch interessieren

Braucht Autonomie Bewusstsein? KI vs. Selbstbestimmung

KI-Systeme handeln eigenständig, doch echte Selbstbestimmung braucht Bewusstsein. Was autonome Maschinen von bewussten Menschen unterscheidet.

Verlernen wir das Denken durch KI? Kognitive Auslagerung

Kognitive Auslagerung an KI ist kein Zukunftsszenario — sie passiert jetzt und verändert, wie dein Gehirn Probleme löst. Was du dagegen tun kannst.

Wie denkt eine KI? Und verstehen wir uns selbst?

Wir versuchen zu entschlüsseln, wie KI denkt — dabei haben wir kaum verstanden, wie unser eigenes Denken funktioniert. Zwei Blackboxen im Vergleich.